产品功能

本页面介绍了DataArts Studio服务各个组件支持的主要功能。关于各功能支持的地域(Region)信息,可通过控制台查询详情。

数据集成:多种方式异构数据源高效接入

数据集成提供30+同构/异构数据源之间数据集成的功能,帮助您实现数据自由流动。支持自建和云上的文件系统,关系数据库,数据仓库,NoSQL,大数据云服务,对象存储等数据源。

数据集成基于分布式计算框架,利用并行化处理技术,支持用户稳定高效地对海量数据进行移动,实现不停服数据迁移,快速构建所需的数据架构。

数据集成提供全向导式任务管理界面,帮助用户在几分钟内完成数据迁移任务的创建,轻松应对复杂迁移场景。数据集成支持的功能主要有:

- 表/文件/整库迁移

支持批量迁移表或者文件,还支持同构/异构数据库之间整库迁移,一个作业即可迁移几百张表。

- 增量数据迁移

支持文件增量迁移、关系型数据库增量迁移、HBase增量迁移,以及使用Where条件配合时间变量函数实现增量数据迁移。

- 事务模式迁移

支持当迁移作业执行失败时,将数据回滚到作业开始之前的状态,自动清理目的表中的数据。

- 字段转换

支持去隐私、字符串操作、日期操作等常用字段的数据转换功能。

- 文件加密

在迁移文件到文件系统时,数据集成支持对写入云端的文件进行加密。

- MD5校验一致性

支持使用MD5校验,检查端到端文件的一致性,并输出校验结果。

- 脏数据归档

支持将迁移过程中处理失败的、被清洗过滤掉的、不符合字段转换或者不符合清洗规则的数据自动归档到脏数据日志中,方便用户分析异常数据。并支持设置脏数据比例阈值,来决定任务是否成功。

数据架构:数据建模可视化、自动化、智能化

DataArts Studio数据架构践行数据治理方法论,将数据治理行为可视化,打通数据基础层到汇总层、集市层的数据处理链路,落地数据标准和数据资产,通过关系建模、维度建模实现数据标准化,通过统一指标平台建设,实现规范化指标体系,消除歧义、统一口径、统一计算逻辑,对外提供主题式数据查询与挖掘服务。

DataArts Studio数据架构主要包括以下三个部分:

- 主题设计

构建统一的数据分类体系,用于目录化管理所有业务数据,便于数据的归类,查找,评价,使用。通过分层架构对数据分类和定义,可帮助用户厘清数据资产,明确业务领域和业务对象的关联关系。

- 数据标准

构建统一的数据标准体系,数据标准流程化、系统化。用户可基于国家标准或行业标准,对每一行数据、每一个字段的具体取值进行标准化,从而提升数据质量和易用性。

- 数据建模

构建统一的数据模型体系,通过规范定义和数据建模,自顶向下构建企业数据分层体系,沉淀企业数据公共层和主题库,便于数据的流通、共享、创造、创新,提升数据使用效率,极大的减少数据冗余,混乱,隔离,不一致以及谬误等。

DataArts Studio数据架构支持的数据建模方法有:

- 关系建模

关系建模是用实体关系(Entity Relationship,ER)模型描述企业业务,它在范式理论上符合3NF,出发点是整合数据,将各个系统中的数据以整个企业角度按主题进行相似性组合和合并,并进行一致性处理,为数据分析决策服务,但是并不能直接用于分析决策。

- 维度建模

维度建模是以维度建模理论为基础,构建总线矩阵、抽象出事实和维度,构建维度模型和事实模型,同时对报表需求进行抽象整理出相关指标体系,构建出汇总模型。

- 数据集市

又称为DM(Data Mart),DM面向展现层,数据有多级汇总,由一个特定的分析对象及其相关的统计指标组成的,向用户提供了以统计粒度为主题的所有统计数据。

- 关系建模

有关数据架构更多详细信息,请参见数据架构概述、流程设计、主题设计、逻辑建模、码表管理、数据标准、命名词典、数仓规划、关系建模、维度建模、数据集市、业务指标、技术指标、审核中心和配置中心。

数据开发:一站式协同开发平台

DataArts Studio数据开发是一个一站式敏捷大数据开发平台,提供可视化的图形开发界面、丰富的数据开发类型(脚本开发和作业开发)、全托管的作业调度和运维监控能力,内置行业数据处理pipeline,一键式开发,全流程可视化,支持多人在线协同开发,支持管理多种大数据云服务,极大地降低了用户使用大数据的门槛,帮助用户快速构建大数据处理中心。

数据开发支持数据管理、脚本开发、作业开发、资源管理、作业调度、运维监控等操作,帮助用户轻松完成整个数据的处理分析流程。

- 数据管理

- 支持管理DWS、DLI、MRS Hive等多种数据仓库。

- 支持可视化和DDL方式管理数据库表。

- 脚本开发

- 提供在线脚本编辑器,支持多人协作进行SQL、Shell、Python脚本在线代码开发和调测。

- 支持使用变量。

- 作业开发

- 提供图形化设计器,支持拖拽式工作流开发,快速构建数据处理业务流水线。

- 预设数据集成、SQL、Spark、Shell、机器学习等多种任务类型,通过任务间依赖完成复杂数据分析处理。

- 支持导入和导出作业。

- 资源管理

支持统一管理在脚本开发和作业开发使用到的file、jar、archive类型的资源。

- 作业调度

- 支持单次调度、周期调度和事件驱动调度,周期调度支持分钟、小时、天、周、月多种调度周期。

- 作业调度支持多种云服务的多种类型的任务混合编排,高性能的调度引擎已经经过几百个应用的检验。

- 运维监控

- 支持对作业进行运行、暂停、恢复、终止等多种操作。

- 支持查看作业和其内各任务节点的运行详情。

- 支持配置多种方式报警,作业和任务发生错误时可及时通知相关人,保证业务正常运行。

有关数据开发更多详细信息,请参见数据开发概述、数据管理、脚本开发、作业开发、运维调度和配置管理。

数据质量:可控可检验

数据质量模块支持对数据质量进行监控,数据质量可检验,帮助用户及时发现数据质量问题。

- 数据质量监控

数据质量监控是对数据库里的数据质量进行质量管理的工具,您可以配置数据质量检查规则,在线监控数据准确性。

数据质量可以从完整性、有效性、及时性、一致性、准确性、唯一性六个维度进行单列、跨列、跨行和跨表的分析,也支持数据的标准化,能够根据数据标准自动生成标准化的质量规则,支持周期性的监控。

图4 数据质量规则体系

数据资产管理:360度全链路数据资产可视化

DataArts Studio提供企业级的元数据管理,厘清信息资产。数据资产管理可视,支持钻取、溯源等。通过数据地图,实现数据资产的数据血缘和数据全景可视,提供数据智能搜索和运营监控。

- 元数据管理

元数据管理模块是数据湖治理的基石,支持创建自定义策略的采集任务,可采集数据源中的技术元数据。支持自定义业务元模型,批量导入业务元数据,关联业务和技术元数据、全链路的血缘管理和应用。

图5 全链路数据血缘

- 数据地图

数据地图围绕数据搜索,服务于数据分析、数据开发、数据挖掘、数据运营等数据表的使用者和拥有者,提供方便快捷的数据搜索服务,拥有功能强大的血缘信息及影响分析。

- 在数据地图中,可通过关键词搜索数据资产,支持模糊搜索,快速检索,定位数据。

- 使用数据地图根据表名直接查看表详情,快速查阅明细信息,掌握使用规则。获得数据详细信息后,可添加额外描述。

- 通过数据地图的血缘分析可以查看每个数据表的来源、去向,并查看每个表及字段的加工逻辑。

- 对数据资产,可以从业务角度定义分类或标签。

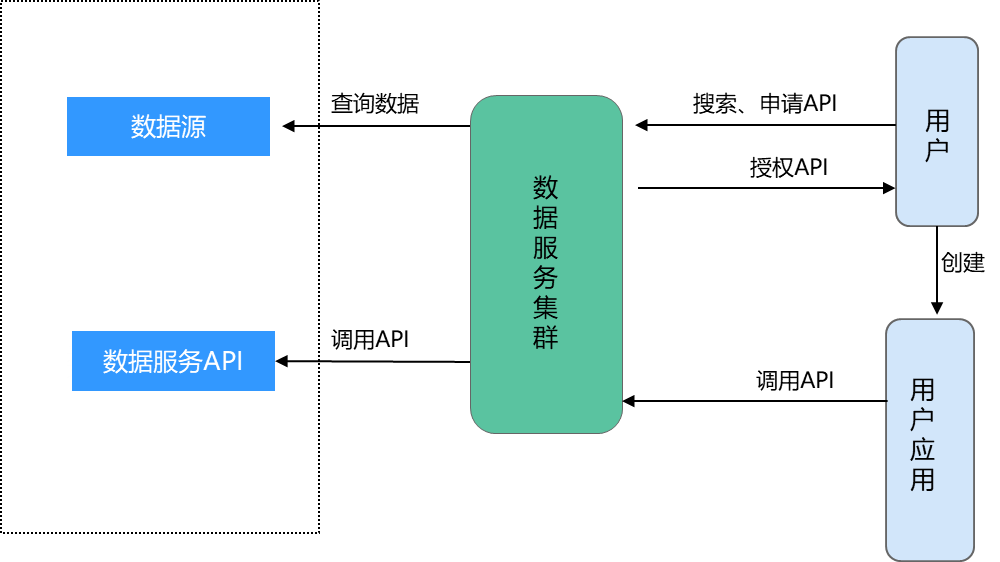

数据服务:提升访问查询检索效率

DataArts Studio数据服务旨在为企业搭建统一的数据服务总线,帮助企业统一管理对内对外的API服务。数据服务为您提供快速将数据表生成数据API的能力,涵盖API发布、管理、运维的全生命周期管理,帮助您简单、快速、低成本、低风险地实现微服务聚合、前后端分离、系统集成,向合作伙伴、开发者开放功能和数据。

有关数据服务更多详细信息,请参见数据服务简介、创建API、调试API、发布API、审核API、管理API、编排API、调用API和授权API调用。

数据安全:全方位安全保障

- 网络安全

基于网络隔离、安全组规则以及一系列安全加固项,实现租户隔离和访问权限控制,保护系统和用户的隐私及数据安全。

- 用户权限策略

基于角色的访问控制,用户通过角色与权限进行关联,并支持细粒度权限策略,可满足不同的授权需求。针对不同的用户,DataArts Studio提供了管理者、开发者、部署者、运维者、访客五种不同的角色,各个角色拥有不同的权限。

- 数据安全

针对数据架构、数据服务等关键流程,DataArts Studio提供了审核流程。

数据的分级分类管理,数据的全生命周期管理,保证数据的隐私合规、可回溯。

有关数据安全更多详细信息,请参见数据安全概述、访问权限管理、敏感数据识别、隐私保护管理、数据安全运营、管理回收站和管理配置中心。

管理中心

管理中心提供的实例管理、工作空间管理、数据连接管理、资源迁移功能。

有关管理中心更多详细信息,请参见DataArts Studio支持的数据源、实例管理、工作空间管理、创建数据连接和资源迁移。