配置元数据采集任务

本章主要介绍如何通过配置元数据采集策略新建采集任务,不同类型的数据源对应的采集策略不尽相同。元数据管理依据采集任务的配置策略,采集对应的技术元数据信息。

约束与限制

- 当元数据采集任务未指定采集范围时,默认采集该数据连接下的所有数据表/文件。采集任务运行完成后,如果该数据连接下有新增数据表/文件,则需再次运行元数据采集任务,才能采集到新增数据表/文件的元数据。

- Oracle元数据采集前,需要确保数据连接中的数据库用户需要有数据表的读写权限以及对元数据的读取权限。详见Oracle数据连接参数说明中的用户授权指导。Oracle采集过程中的用户名、表名中不能包含英文句号,否则会采集失败。

- 受MRS集群限制,默认情况下元数据采集任务无法直接采集到Hive分区表的元数据。

如果需要采集Hive分区表的元数据,需要在MRS集群内的HiveServer(角色)->自定义下的“hive.server.customized.configs”参数值中新增名称hive-ext.display.desc.statistic.stats,且值为true。详情请参见配置MRS集群Hive分区表支持元数据采集。

前提条件

-

元数据采集支持丰富的数据源类型,对于DWS、DLI、MRS HBase、MRS Hive、RDS和ORACLE类型的数据源,首先需要在管理中心创建数据连接。如需采集其他数据源(如OBS、CSS、GES等)元数据,无需在管理中心创建数据连接。

- 采集Hudi元数据前,需要先在Hudi表开启“同步hive表配置”,然后才能通过采集MRS Hive元数据的方式采集Hudi表的元数据。

-

如果需要采集Hive分区表的元数据,需要在MRS集群内的HiveServer(角色)->自定义下的“hive.server.customized.configs”参数值中新增名称hive-ext.display.desc.statistic.stats,且值为true。详情请参见配置MRS集群Hive分区表支持元数据采集。

新增采集任务

- 在DataArts Studio控制台首页,选择对应工作空间的“数据目录”模块,进入数据目录页面。

- 选择。

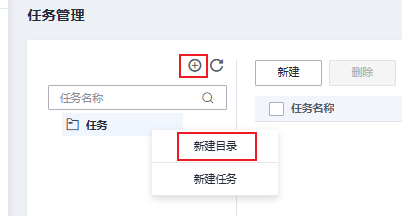

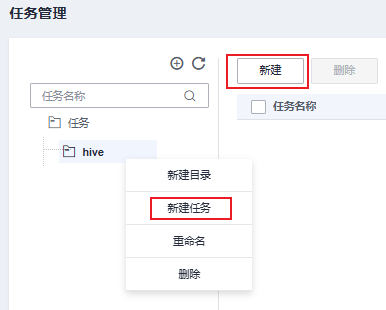

- 选择采集任务所归属的目录。如果未新建目录请参见图1创建进行。

- 单击页面上方“新建”或者右键单击任务菜单,单击“新增任务”,在弹出的对话框中,配置相关参数,新建采集任务。

新建任务有如图2所示的两个入口。

- 配置基本参数,参考表1。

表1 基本配置说明 参数名

说明

任务名称

采集任务的名称,只能包含中文、英文字母、数字和下划线,且长度不能超过62个字符。

描述

为更好的识别采集任务,此处加以描述信息。描述信息长度不能超过255个字符。

选择目录

采集任务的存储目录,可选择已创建的目录。目录创建请参见图1。

- 配置数据源信息,参考表2。

表2 数据源信息参数说明 参数名

说明

数据连接类型

从下拉列表中选择数据连接类型。

说明:元数据采集支持丰富的数据源类型,对于DWS、DLI、MRS HBase、MRS Hive、RDS和ORACLE类型的数据源,首先需要在管理中心创建数据连接。如需采集其他数据源(如OBS、CSS、GES等)元数据,无需在管理中心创建数据连接。

- DWS

- DLI

- MRS HBase

- MRS Hive

- ORACLE

- RDS

数据连接

- 所选数据连接类型中已创建数据连接,支持从下拉列表中选择。

- 所选数据连接类型中未创建数据连接,请单击“新建”,创建新的数据连接。

数据库

(或数据库和schema、命名空间)

呈现待采集的数据库(或数据库和schema、命名空间)和数据表。

- 单击数据库(或数据库和schema、命名空间)后的“设置”,设置采集任务扫描的数据库(或数据库和schema、命名空间)范围。当不进行设置时,默认选择该数据连接下的所有数据库(或数据库和schema、命名空间)。

- 单击数据表后的“设置”,设置采集任务扫描的数据表范围。当不进行设置时,默认选择数据库(或数据库和schema、命名空间)下的所有数据表。

- 当数据库(或数据库和schema、命名空间)和数据表均不设置时,则采集任务扫描的数据范围为该数据连接下的所有数据表。

- 单击“清除”,可对已选择的数据库(或数据库和schema、命名空间)、数据表进行修改。

数据表

过滤临时表

仅当数据连接类型为MRS Hive时支持此参数,数据表选择all时生效。

本参数开启时,可过滤Hudi库MOR模式生成的*_ro、*_rt表及CDM作业生成的*_stage_read_*临时表。

CSS

选择集群

选择待采集数据存储的CSS集群。

您也可以单击“新建”,创建CSS集群,创建完成后单击“刷新”,选择新建的CSS集群即可。

绑定Agent

请选择由CDM集群提供的Agent。

用户也可以单击“新建”,创建新的Agent,创建完成后单击“刷新”,选择新的Agent即可。

索引

用于存储Elasticsearch的数据,类似关系型数据库的Database。是一个或多个分片分组在一起的逻辑空间。

GES

选择图

选择存储了以“关系”为基础的结构数据的图。

绑定Agent

请选择由CDM集群提供的Agent。

用户也可以单击“新建”,创建新的Agent,创建完成后单击“刷新”,选择新的Agent即可。

OBS连接

OBS桶

选择待采集数据归属的OBS桶。

OBS路径

选择待采集数据在OBS桶中的存储路径。

采集范围

选择待采集数据的采集范围。

- 选择“当前文件夹”,采集任务仅采集OBS路径中设置的文件夹下的对象。

- 选择“当前文件夹和所有子文件夹”,采集任务会采集OBS路径中设置的文件夹下所有的对象,包括其子文件夹下的对象

采集内容

选择待采集数据的采集内容。

- 选择“文件夹和对象”,采集任务采集文件夹和对象。

- 选择“ 文件夹”,采集任务仅采集文件夹。

DIS

是否采集转储任务

勾选“采集”表示采集转储任务。

采集通道

DIS服务的实例即通道。此参数表示选择通道,进行采集。

- 元数据采集参数配置,参考表3。

仅当数据连接类型为DWS、DLI、MRS HBase、MRS Hive、ORACLE、RDS时,支持配置元数据采集参数。

表3 元数据采集参数说明 参数名

说明

数据源元数据已更新

当数据连接中元数据发生变化时,通过配置更新策略,设置数据目录中元数据的更新方式。

需要注意的是配置的更新、删除策略是作用在用户配置的数据库、数据表的范围内的。

- 勾选“仅更新数据目录中的元数据”:采集任务仅更新数据目录已经采集到的元数据

- 勾选“仅添加新元数据”:采集任务仅采集数据源中存在,但是数据目录中不存在的元数据

- 勾选“更新数据目录中的元数据、添加新元数据”:采集任务全量同步数据源中的元数据

- 勾选“忽略更新、添加操作”:不采集数据源中的元数据

数据源元数据已删除

当数据连接中元数据发生变化时,通过配置删除策略,设置数据目录中元数据的更新方式。

- 勾选“从数据目录中删除元数据”:当数据源中的某些元数据已经被删除,数据目录中也将同步删除对应的元数据

- 勾选“忽略删除”:当数据源中的某些元数据已经被删除,数据目录中不同步删除对应元数据。

采集视图血缘

仅数据源类型为DWS时,呈现此参数。

对于与视图定义相关的表或视图,需要采集血缘时,需要开启本参数。

单个数据表采集超时时间

仅数据源类型为DWS时,呈现此参数。

单个数据表元数据采集的时长如果超过了此处设置的超时时间,此数据表的元数据采集会失败。不配置时,超时时间默认为30分钟。

在个别表很大的情况下,元数据采集时间会超长。您可以设置超时时间,然后针对这些个别大表单独配置采集任务。

- 勾选数据概要时的参数配置,参考表4。

- 仅当数据连接类型为DWS、DLI时,支持配置数据概要。

- 如无特殊需求时,建议您无需开启数据概要。开启数据概要后会对数据源端产生较大的SQL执行压力,导致元数据采集任务时间超出预期。

- 数据分类配置说明(仅当数据目录组件中具备数据安全功能时,支持配置该选项;当前暂不支持关联独立数据安全组件中的敏感数据识别规则)

- 数据分类:勾选此项参见新建数据分类(待下线)新建分类规则组或者选中已有分类规则组,实现自动识别数据并添加分类。

- 数据分级:勾选“根据数据分类结果更新数据表密级”,表示可根据匹配的分类规则中,将密级最高的设置为表的密级。

- 数据同步:勾选“手动同步分类结果”,表示“数据地图 > 数据目录 > 列属性”中呈现的数据列,在采集任务执行完毕后,不会自动添加分类和密级属性。需要用户前往“元数据采集 > 任务监控 ”页面,找到任务实例,选择“操作 > 更多 > 扫描结果”,查看采集任务的执行结果,确认分类结果是否匹配。勾选分类匹配字段前的复选框,单击“同步”,即可将分类和密级属性手动同步到资产。

仅DWS、DLI数据源支持创建采集任务时添加数据分类,实现自动识别。另外,只可给数据表的列和OBS对象添加分类。

- 配置基本参数,参考表1。

- 单击“下一步”,选择调度方式,支持单次调度和周期调度两种方式。

单次调度:超时时间表示如果任务运行的时长超过了设置的超时时间,任务会被认定运行失败。

周期调度的相关参数配置请参见表5。

- 单次调度会产生手动任务的实例,手动任务的特点是没有调度依赖,只需要手动触发即可。

- 周期调度会产生周期实例,周期实例是周期任务达到启用调度所配置的周期性运行时间时,被自动调度起来的实例快照。

- 周期任务每调度一次,便生成一个实例工作流。用户可以对已调度起的实例任务进行日常的运维管理,如查看运行状态,对任务进行终止、重跑等操作。

- 单击“提交”,采集任务创建成功。

管理采集任务

- 在DataArts Studio控制台首页,选择对应工作空间的“数据目录”模块,进入数据目录页面。

- 选择。

在采集任务页面,可查看所有已创建的采集任务。

| 参数名 | 说明 |

|---|---|

| 任务名称 | 采集任务的名称。 单击采集任务名称,可查看该采集任务的采集策略和调度属性。 |

| 数据源类型 | 数据连接的名称。 |

| 调度状态 | 显示采集任务的调度方式,单击 |

| 调度周期 | 显示采集任务的调度频率,单击 |

| 描述 | 展示采集任务的描述信息。 |

| 创建人 | 展示采集任务的创建人。 |

| 最近运行时间 | 展示采集任务的最近运行时间。 |

| 操作 | 对已创建的采集任务可进行如下操作:

|

配置MRS集群Hive分区表支持元数据采集

- 使用admin账户登录MRS服务的Manager页面。

- 在Manager页面选择“集群 > 服务 > Hive > 配置 > 全部配置”,选择HiveServer(角色)->自定义,在“hive.server.customized.configs”参数值中新增hive-ext.display.desc.statistic.stats名称,值为true,如图3所示。

- 自定义参数配置完成后,单击左上角的“保存”,在弹窗中单击“确定”保存配置。 图4 保存配置

- 保存成功后,切换到实例页签,选择配置已过期的实例后,单击“更多 > 滚动重启实例”,使配置生效。 图5 滚动重启实例