Wav2Lip基于DevServer适配PyTorch NPU训练指导(6.3.902)

本文档主要介绍如何在ModelArts Lite的DevServer环境中,使用NPU卡训练Wav2Lip模型。本文档中提供的Wav2Lip模型,是在原生Wav2Lip代码基础上适配后的模型,可以用于NPU芯片训练。

Wav2Lip是一种基于对抗生成网络的由语音驱动的人脸说话视频生成模型。主要应用于数字人场景。不仅可以基于静态图像来输出与目标语音匹配的唇形同步视频,还可以直接将动态的视频进行唇形转换,输出与输入语音匹配的视频,俗称“对口型”。该技术的主要作用就是在将音频与图片、音频与视频进行合成时,口型能够自然。

Wav2Lip模型的输入为任意的一段视频和一段语音,输出为一段唇音同步的视频。

Wav2Lip的网络模型总体上分成三块:生成器、判别器和一个预训练好的唇音同步判别模型Pre-trained Lip-sync Expert。

- 生成器是基于encoder-decoder的网络结构,分别利用2个encoder(speech encoder和identity encoder)去对输入的语音和视频人脸进行编码,并将二者的编码结果进行拼接,送入到face decoder中进行解码得到输出的视频帧。

- 判别器Visual Quality Discriminator对生成结果的质量进行规范,提高生成视频的清晰度。

- 引入预训练的唇音同步判别模型Pre-trained Lip-sync Expert,作为衡量生成结果的唇音同步性的额外损失,可以更好的保证生成结果的唇音同步性。

方案概览

本方案介绍了在ModelArts的DevServer上使用昇腾计算资源开展Wav2Lip训练的详细过程。完成本方案的部署,需要先联系您所在企业的华为方技术支持购买DevServer资源。

本方案目前仅适用于企业客户。

环境配置要求

准备一台ModelArts的DevServer物理机环境,推荐使用“西南-贵阳一”Region上的DevServer资源和Ascend Snt9B单机单卡。

|

模型 |

版本 |

|---|---|

|

CANN |

7.0.1 |

|

PyTorch |

2.1 |

|

Python |

3.10 |

获取软件

获取Wav2Lip Ascend适配代码ascendcloud-aigc-6.3.902-*.tar.gz文件。获取路径:Support网站。

如果没有软件下载权限,请联系您所在企业的华为方技术支持下载获取。

ascendcloud-aigc-6.3.902-*.tar.gz文件名中的*表示具体的时间戳,以包名的实际时间为准。

Step1 准备环境

- 请参考DevServer资源开通,购买DevServer资源,并确保机器已开通,密码已获取,能通过SSH登录,不同机器之间网络互通。

购买DevServer资源时如果无可选资源规格,需要联系华为云技术支持申请开通。

当容器需要提供服务给多个用户,或者多个用户共享使用该容器时,应限制容器访问Openstack的管理地址(169.254.169.254),以防止容器获取宿主机的元数据。具体操作请参见禁止容器获取宿主机元数据。

- 检查环境。

- SSH登录机器后,检查NPU设备检查。运行如下命令,返回NPU设备信息。

npu-smi info

如出现错误,可能是机器上的NPU设备没有正常安装,或者NPU镜像被其他容器挂载。请先正常安装固件和驱动,或释放被挂载的NPU。

- 检查docker是否安装。

docker -v #检查docker是否安装

如尚未安装,运行以下命令安装docker。

yum install -y docker-engine.aarch64 docker-engine-selinux.noarch docker-runc.aarch64

- 配置IP转发,用于容器内的网络访问。执行以下命令查看net.ipv4.ip_forward配置项的值,如果为1,可跳过此步骤。

sysctl -p | grep net.ipv4.ip_forward

如果net.ipv4.ip_forward配置项的值不为1,执行以下命令配置IP转发。sed -i 's/net\.ipv4\.ip_forward=0/net\.ipv4\.ip_forward=1/g' /etc/sysctl.conf sysctl -p | grep net.ipv4.ip_forward

- SSH登录机器后,检查NPU设备检查。运行如下命令,返回NPU设备信息。

- 获取基础镜像。建议使用官方提供的镜像部署推理服务。

西南-贵阳一:swr.cn-southwest-2.myhuaweicloud.com/atelier/pytorch_2_1_ascend:pytorch_2.1.0-cann_7.0.0-py_3.9-hce_2.0.2312-aarch64-snt9b-20240312154948-219655b

docker pull ${image_url} - 启动容器镜像。启动前请先按照参数说明修改${}中的参数。可以根据实际需要增加修改参数。

export work_dir="自定义挂载的工作目录" export container_work_dir="自定义挂载到容器内的工作目录" export container_name="自定义容器名称" export image_name="swr.cn-southwest-2.myhuaweicloud.com/atelier/pytorch_2_1_ascend:pytorch_2.1.0-cann_7.0.0-py_3.9-hce_2.0.2312-aarch64-snt9b-20240312154948-219655b" // 启动一个容器去运行镜像 docker run -itd \ --device=/dev/davinci0 \ --device=/dev/davinci_manager \ --device=/dev/devmm_svm \ --device=/dev/hisi_hdc \ -v /usr/local/bin/npu-smi:/usr/local/bin/npu-smi \ -v /usr/local/dcmi:/usr/local/dcmi \ -v /etc/ascend_install.info:/etc/ascend_install.info \ -v /sys/fs/cgroup:/sys/fs/cgroup:ro \ -v /usr/local/Ascend/driver:/usr/local/Ascend/driver \ --shm-size 32g \ --net=bridge \ -v ${work_dir}:${container_work_dir} \ --name ${container_name} \ ${image_name} bash参数说明:

- --name ${container_name} 容器名称,进入容器时会用到,此处可以自己定义一个容器名称。

- -v ${work_dir}:${container_work_dir} 代表需要在容器中挂载宿主机的目录。宿主机和容器使用不同的文件系统。work_dir为宿主机中工作目录,目录下存放着训练所需代码、数据等文件。container_work_dir为要挂载到的容器中的目录。为方便两个地址可以相同。

- ${image_name} 代表 ${image_name}。

- 通过容器名称进入容器中。

docker exec -it ${container_name} bash

Step2 安装依赖和软件包

- Python版本要求3.10,如果不满足的话,建议更新容器的conda环境的Python版本。

# 输入如下命令,待conda界面准备完成后输入y,等待自动下载安装 conda create --name py310 python=3.10

参数说明:

- --name:该参数为新环境名字,可以自定义一个,此处以py310举例。

- python=新环境Python版本

# 完成后输入如下命令激活新环境 conda activate py310

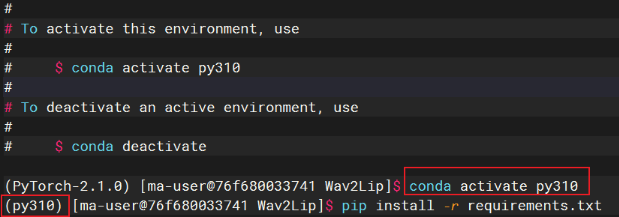

激活新conda环境后控制台显示(py310)即为切换成功,如下图所示。

图1 激活新conda环境

- 从github拉取Wav2Lip代码。

cd /home/ma-user git clone https://github.com/Rudrabha/Wav2Lip.git

如果出现报错SSL certificate problem: self signed certificate in certificate chain

图2 报错SSL certificate problem

可采取忽略SSL证书验证:使用以下命令来克隆仓库,它将忽略SSL证书验证。

git clone -c http.sslVerify=false https://github.com/Rudrabha/Wav2Lip.git

- 安装Wav2Lip Ascend软件包。

- 将获取到的Wav2Lip Ascend软件包ascendcloud-aigc-*.tar.gz文件上传到容器的/home/ma-user/Wav2Lip目录下。获取路径:Support网站。

- 解压ascendcloud-aigc-*.tar.gz文件,解压后将里面文件与对应Wave2Lip文件进行替换。

cd /home/ma-user/Wav2Lip tar -zxvf ascendcloud-aigc-6.3.902-*.tar.gz tar -zxvf ascendcloud-aigc-poc-Wav2Lip_Ascend.tar.gz mv Wav2Lip_code/* ./ rm -rf ascendcloud-aigc-* Wav2Lip_code/

ascendcloud-aigc-6.3.902-*.tar.gz后面的*表示时间戳,请按照实际替换。

要替换的文件目录结构如下所示:

|---Wav2Lip_code/ --- color_syncnet_train.py #训练expert discriminator唇形同步鉴别器 --- inference.py #推理代码,可以与任意音频或视频进行口型同步 --- preprocess.py #对初始视频数据进行推理 --- read.txt #关于包版本兼容问题的一些处理方案 --- requirements.txt #建议的依赖包版本 --- wav2lip_train.py #训练 Wav2Lip 模型

- 安装Python依赖包,文件为requirements.txt文件。

pip install -r requirements.txt

由于librosa、numba、llvmlite包的版本兼容问题,会出现报错ModuleNotFoundError: No module named 'numba.decorators'。

此时进入Python包librosa安装位置,打开文件site-packages/librosa/util/decorators.py,修改文件如下:

import warnings from decorator import decorator import six #注释此行 #from numba.decorators import jit as optional_jit #修改此行如下 #__all__ = ['moved', 'deprecated', 'optional_jit'] __all__ = ['moved', 'deprecated']

Step3 训练Wav2Lip模型

- 准备预训练模型。下载需要使用的预训练模型。

- 处理初始视频数据集。

- 将下载好的人脸检测预训练模型上传到/home/ma-user/Wav2Lip/face_detection/detection/sfd/s3fd.pth目录。

- 下载LRS2数据集。数据集文件夹结构如下:

├── LRS2_partly | ├── main | │ ├── five-digit numbered video IDs ending with (.mp4) | │ ├── 00001.mp4 | │ ├── 00002.mp4

- 对数据集进行预处理。具体命令如下。

python preprocess.py --data_root ./LRS2_partly --preprocessed_root lrs2_preprocessed/

data_root参数为原始视频根目录,preprocessed_root参数为处理后生成的数据集目录。

处理后数据目录如下所示。preprocessed_root (lrs2_preprocessed) ├── main | ├── Folders with five-digit numbered video IDs(00001) | │ ├── *.jpg | │ ├── audio.wav | ├── 00001 | │ ├── *.jpg | │ ├── audio.wav

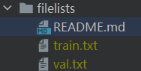

- 将LRS2文件列表中的.txt文件(train、val)放入该filelists文件夹中。

图3 filelists文件夹

train.txt和val.txt内容参考如下,为处理后视频数据的目录名字。

图4 train.txt和val.txt内容

- 训练专家唇形同步鉴别器。

如果使用LRS2数据集,可选择跳过此步骤。如果使用自己的数据集,训练命令参考如下。

python color_syncnet_train.py --data_root ./lrs2_preprocessed/main/ --checkpoint_dir ./savedmodel/syncnet_model/ --checkpoint_path ./checkpoints/lipsync_expert.pth

参数说明:

- --data_root :处理后的视频数据目录,与train.txt内容拼接后得到单个数据目录,例如:lrs2_preprocessed/main/00001。

- --checkpoint_dir :此目录用于保存模型。

- -checkpoint_path :(可选)可基于此目录的lipsync_expert模型继续进行训练,如果重新训练则不需要此参数。

默认每10000 step保存一次模型。

- 训练Wav2Lip模型。

训练Wav2Lip模型时需要使用专家唇形同步鉴别器。可以使用上一步3中的训练结果,也可以直接下载官方提供的预训练权重来使用。

具体训练命令如下。python wav2lip_train.py --data_root ./lrs2_preprocessed/main/ --checkpoint_dir ./savedmodel --syncnet_checkpoint_path ./checkpoints/lipsync_expert.pth --checkpoint_path ./checkpoints/wav2lip.pth

参数说明:

- --data_root :处理后的视频数据目录,与train.txt内容拼接后得到单个数据目录,例如:lrs2_preprocessed/main/00001。

- --checkpoint_dir :此目录用于保存模型。

- --syncnet_checkpoint_path :专家鉴别器的目录。

- --checkpoint_path :(可选)可基于此目录的Wav2Lip模型继续进行训练,如果重新训练则不需要此参数。

默认每3000 step保存一次模型。

专家鉴别器的评估损失应降至约 0.25,Wav2Lip评估同步损失应降至约 0.2,以获得良好的结果。

常见问题

如果训练时遇到报错ImportError: /usr/lib64/libc.so.6: version `GLIBC_2.34' not found,是由于编译Python的glibc环境版本过旧导致,建议重新安装python。

重新安装python命令如下。

# 输入如下命令,待conda界面准备完成后输入y,等待自动下载安装 conda create --name py310 python=3.10

参数说明:

- --name:该参数为新环境名字,可以自定义一个,此处以py310举例。

- python=新环境Python版本

# 完成后输入如下命令激活新环境 conda activate py310

激活新conda环境后控制台显示(py310)即为切换成功,如下图所示。