使用CDM迁移数据至DLI

CDM提供了可视化的迁移任务配置页面,支持多种数据源到数据湖的迁移能力。

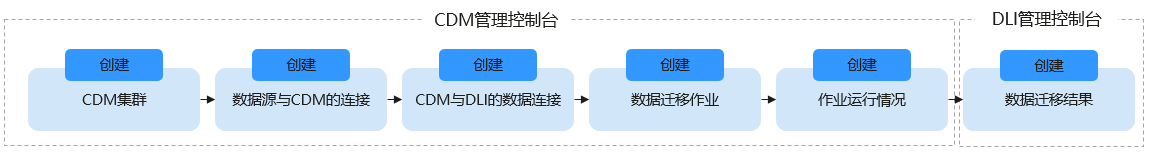

本节操作介绍使用CDM迁移工具将数据从数据源迁移至DLI的操作步骤。

步骤1:创建CDM集群

CDM集群用于执行数据迁移作业,将数据从数据源迁移至DLI。

- 登录CDM管理控制台,单击“购买云数据迁移服务”。

- 配置集群参数。

- 其中CDM集群的区域、虚拟私有云、子网、安全组、企业项目建议选择与数据源和DLI一致。

- 集群创建好以后不支持修改规格,如果需要使用更高规格,需要重新创建。

更多CDM集群参数配置说明请参考创建集群。

- 确认无误后单击“立即购买”进入规格确认界面。

- 单击“提交”,系统开始自动创建CDM集群,在“集群管理”界面可查看创建进度。

步骤2:创建数据源与CDM的数据连接

本例以MySQL数据源为例,介绍创建数据源与CDM的数据连接的操作步骤。

- 进入CDM主界面,单击左侧导航上的“集群管理”,找到步骤1:创建CDM集群章节创建的集群“cdm-aff1”。

- 单击CDM集群后的“作业管理”,进入作业管理界面。

- 选择,进入选择连接器类型的界面,如图2所示。

- 选择“云数据库 MySQL”后单击“下一步”,配置云数据库 MySQL连接的参数。

单击“显示高级属性”可查看更多可选参数。

具体请参见配置云数据库MySQL/MySQL数据库连接。

这里保持默认,必填参数如表1所示。

表1 MySQL连接参数 参数名

说明

取值样例

名称

输入便于记忆和区分的连接名称。

mysqllink

数据库服务器

MySQL数据库的IP地址或域名。

-

端口

MySQL数据库的端口。

3306

数据库名称

MySQL数据库的名称。

sqoop

用户名

拥有MySQL数据库的读、写和删除权限的用户。

admin

密码

用户的密码。

-

使用本地API

使用数据库本地API加速(系统会尝试启用MySQL数据库的local_infile系统变量)。

是

使用Agent

Agent功能待下线,无需配置。

-

local_infile字符集

MySQL通过local_infile导入数据时,可配置编码格式。

utf8

驱动版本

CDM连接关系数据库前,需要先上传所需关系数据库的JDK8版本.jar格式驱动。MySQL的驱动请从https://downloads.mysql.com/archives/c-j/选择5.1.48版本下载,从中获取mysql-connector-java-5.1.48.jar,然后进行上传。

-

- 单击“测试”测试参数是否配置无误,“测试”成功后单击“保存”创建该连接,并回到连接管理界面。 图3 创建MySQL连接成功

步骤3:创建CDM与DLI的数据连接

- 进入CDM主界面,单击左侧导航上的“集群管理”,找到步骤1:创建CDM集群章节创建的集群“cdm-aff1”。

- 单击CDM集群后的“作业管理”,进入作业管理界面。

- 选择,进入选择连接器类型的界面,如图4所示。

- 选择“数据湖探索(DLI)”后单击“下一步”,配置DLI连接的参数。

单击“显示高级属性”可查看更多可选参数。具体请参见配置DLI连接。这里保持默认,必填参数如表2所示。

表2 DLI连接参数 参数名

说明

取值样例

名称

连接的名称,根据连接的数据源类型,用户可自定义便于记忆、区分的连接名。

dlilink

访问标识(AK)

访问DLI数据库时鉴权所需的AK和SK。

您需要先创建当前账号的访问密钥,并获得对应的AK和SK。

- 登录控制台,在用户名下拉列表中选择“我的凭证”。

- 进入“我的凭证”页面,选择,如图5所示。

- 单击“确定”,根据浏览器提示,保存密钥文件。密钥文件会直接保存到浏览器默认的下载文件夹中。打开名称为“credentials.csv”的文件,即可查看访问密钥(Access Key Id和Secret Access Key)。 说明:

- 每个用户仅允许新增两个访问密钥。

- 为保证访问密钥的安全,访问密钥仅在初次生成时自动下载,后续不可再次通过管理控制台界面获取。请在生成后妥善保管。

-

密钥(SK)

-

项目ID

DLI服务所在区域的项目ID。

项目ID表示租户的资源,账号ID对应当前账号,IAM用户ID对应当前用户。用户可在对应页面下查看不同Region对应的项目ID、账号ID和用户ID。- 注册并登录管理控制台。

- 在用户名的下拉列表中单击“我的凭证”。

- 在“API凭证”页面,查看账号名和账号ID、IAM用户名和IAM用户ID,在项目列表中查看项目和项目ID。

-

- 单击“测试”测试参数是否配置无误,“测试”成功后单击“保存”创建该连接,并回到连接管理界面。

步骤4:在CDM上创建数据迁移作业

建立完成数据源与CDM、CDM与DLI的数据连接后,需要创建数据迁移作业将数据从数据源迁移至DLI。

- 在集群管理界面,找到步骤1:创建CDM集群章节创建的集群“cdm-aff1”。

- 单击该CDM集群后的“作业管理”,进入作业管理界面。

- 选择,配置作业基本信息。

- 作业名称:输入便于记忆、区分的作业名称,例如:“mysql2dli”。

- 源端作业配置

- 源连接名称:选择已创建的MySQL连接“mysqllink”。

- 使用SQL语句:选择“否”。

- 模式或表空间:选择从MySQL的哪个数据库导出表。

- 表名:选择导出哪张表。

- 其他可选参数保持默认即可。

详细说明可参见配置MySQL源端参数。

- 目的端作业配置

- 目的连接名称:选择已创建的DLI连接“dlilink”。

- 模式或表空间:选择导入到DLI的哪个模式。

- 自动创表:这里选择“不存在时创建”,当下面“表名”参数中配置的表不存在时,CDM会自动在DLI中创建该表。

- 表名:选择导入到DLI的哪张表。

- 高级属性参数-“扩大字符字段长度”:这里选择“是”。

由于MySQL和DLI存储中文时编码不一样,所需的长度也不一样,一个中文字符在UTF-8编码下可能要占3个字节。该参数选择为“是”后,在DLI中自动创表时,会将字符类型的字段长度设置为原表的3倍,避免出现DLI表的字符字段长度不够的报错。

- 其他可选参数保持默认即可。

详细说明可参见配置DWS目的端参数。

- 单击“下一步”进入字段映射界面,CDM会自动匹配源端和目的端的数据表字段,需用户检查字段映射关系是否正确。

- 如果字段映射关系不正确,用户单击字段所在行选中后,按住鼠标左键可拖拽字段来调整映射关系。

- 导入到DLI时需要手动选择DLI的分布列,建议按如下顺序选取:

- 有主键可以使用主键作为分布列。

- 多个数据段联合做主键的场景,建议设置所有主键作为分布列。

- 在没有主键的场景下,如果没有选择分布列,DWS会默认第一列作为分布列,可能会有数据倾斜风险。

- 如果需要转换源端字段内容,可在该步骤配置,详细请参见字段转换,这里选择不进行字段转换。

图6 字段映射

- 单击“下一步”配置任务参数,一般情况下全部保持默认即可。 该步骤用户可以配置如下可选功能:

- 作业失败重试:如果作业执行失败,可选择是否自动重试,这里保持默认值“不重试”。

- 作业分组:选择作业所属的分组,默认分组为“DEFAULT”。在CDM“作业管理”界面,支持作业分组显示、按组批量启动作业、按分组导出作业等操作。

- 是否定时执行:如果需要配置作业定时自动执行可开启。这里保持默认值“否”。

- 抽取并发数:设置同时执行的抽取任务数,适当的抽取并发数可以提升迁移效率,配置原则请参见性能调优。这里保持默认值“1”。

- 是否写入脏数据:如果需要将作业执行过程中处理失败的数据、或者被清洗过滤掉的数据写入OBS中,以便后面查看,可通过该参数配置,写入脏数据前需要在CDM先配置好OBS连接。这里保持默认值“否”即可,不记录脏数据。

图7 任务配置

- 单击“保存并运行”,CDM立即开始执行作业。 图8 作业执行

步骤5:查看数据迁移结果

作业完成后,可以查看作业执行结果及最近90天内的历史信息,包括写入行数、读取行数、写入字节、写入文件数和日志等信息。

- 在CDM查看迁移作业运行情况

- 在集群管理界面,找到步骤1:创建CDM集群章节创建的集群“cdm-aff1”。

- 单击该CDM集群后的“作业管理”,进入作业管理界面。

- 找到步骤4:在CDM上创建数据迁移作业创建的作业“mysql2dli”,查看该作业的执行状态。作业状态为Succeeded即迁移成功。

- 在DLI查看数据迁移结果

- 确认CDM迁移作业运行完成后,登录到DLI管理控制台。

- 单击“SQL编辑器”。