运行应用样例

- 运行前准备

首先下载并本地安装PotPlayer播放器,用于播放AI应用运行结果视频流。

在VSCode中配置端口转发, 操作方法:执行“Ctrl+Shift+P”,输入“Forward a Port”,输入“1554”端口。

图1 配置端口转发

- 编译运行AI应用

- 在“.vscode/task.json”中配置了工程运行时需要执行的任务。

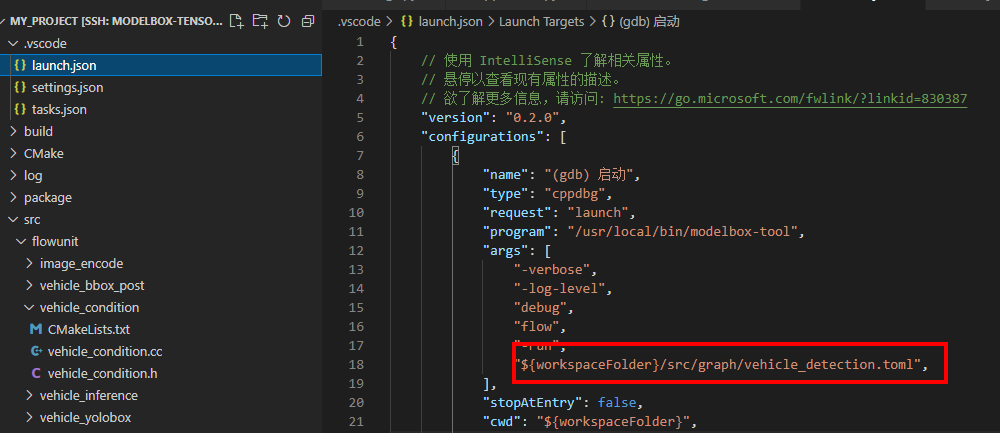

- 在“.vscode/launch.json”配置运行的图路径,这里预置为样例的图。

图2 配置图路径

- 在“.vscode/launch.json”配置日志级别,默认为“debug”。

图3 设置日志级别

- 单击“Run>Run Without Debugging”或者使用快捷键Ctrl+F5运行程序。

图4 运行程序

- 查看运行结果

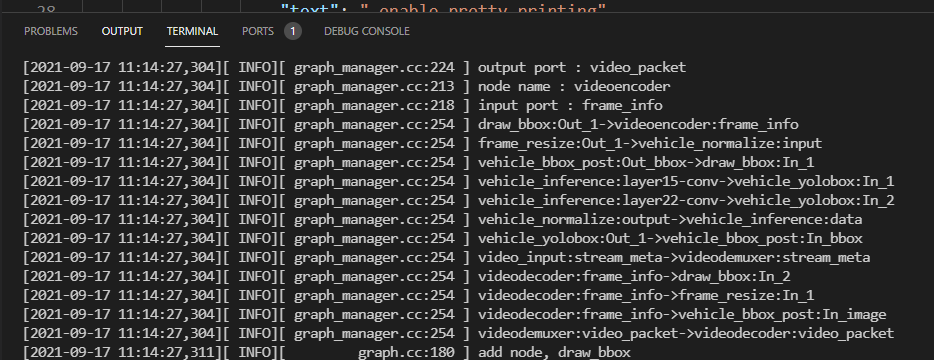

命令执行后,会自动进行工程的编译构建和运行。单击“Terminal”控制台,可以查看实时运行日志。

图5 查看运行日志

运行时,modelbox框架会先加载和解析图,然后运行视频流推理,运行视频推理时日志会很快速的打印,此时在浏览器中输入如下地址可打开rtsp流播放。

rtsp://localhost:1554/video

图6 打开rtsp流播放视频 图7 视频播放推理结果

图7 视频播放推理结果

如果无视频播输出可能是播放早了或者已经播放完了,可以再运行一次图,待控制台开始快速输出大量推理日志后,在浏览器输入地址查看结果。

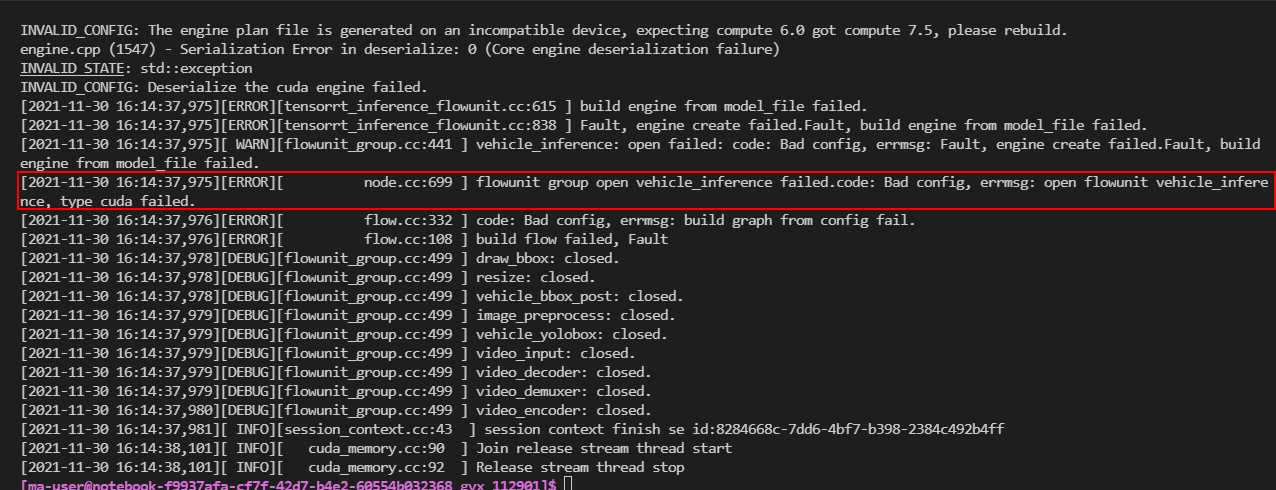

如果运行图时看到下面的日志,代表当前样例使用的模型和开发环境带的加速卡类型不符,则会报如下错误:

图8 模型依赖的硬件和开发环境硬件不匹配时的报错

此时需要重新将TensorRT模型转换成当前开发环境的模型,或者重新创建和模型对应的开发环境。

- 结束运行

在VSCode上方单击停止按钮,或者在Terminal命令行窗口执行“Ctrl + c”,即可结束运行。

图9 结束运行